Desafiando a los detectores: ¿humano o máquina?

Uno de los temas recurrentes en los claustros de profesores es el miedo a que el alumnado copie directamente de una inteligencia artificial como ChatGPT. El hecho de copiar no es nuevo, ya que desde hace ya muchos años Internet ha sido una fuente inagotable de recursos de todo tipo. El problema que aporta la IA es que cada vez que se obtiene una respuesta por parte de la IA, esta es distinta, por lo que no es posible reproducirla de nuevo y aparentemente es única y original.

Los sistemas antiplagio no funcionan adecuadamente y aunque algunos aseguran que son capaces de diferenciar entre lo que ha escrito un humano y una máquina, realmente no existe una certeza absoluta para asegurar que un documento ha sido escrito por una IA y no por una persona.

Hemos hecho una prueba, que no debe considerarse como una evaluación exhaustiva, con un texto generado por una persona y otro redactado por ChatGPT-3.5 Los hemos introducido en varios de los detectores de inteligencia artificial más usados para ver qué probabilidad atribuyen a los textos de haber sido creados artificialmente. Estos sistemas lo que hacen es dar un porcentaje que indica la probabilidad de que el texto haya sido escrito por una IA, es decir, la probabilidad de que constituya un plagio.

A continuación se presentan los textos que se han utilizado para hacer las pruebas.

Texto generado por ChatGPT

El texto se ha copiado tal cual ha sido creado por ChatGPT, sin modificar nada.

Texto generado por un humano

En la siguiente tabla se muestran los resultados. Para que el sistema funcione debe detectar correctamente tanto el texto humano (porcentaje bajo) como el de ChatGPT (porcentaje alto). De lo contrario nos exponemos a falsos positivos, con lo que estaríamos acusando de haber usado la IA siendo falso, como de falsos negativos, estaríamos dando como buenos textos creados por IA. Únicamente Corrector App (una web con un gran conjunto de utilidades para analizar textos) da los resultados algo mejores, aunque insuficientes para tener la seguridad que se necesita en un ambiente escolar y académico.

| Comparación entre algunos servicios antiplagio de IA | ||

| Servicio antiplagio | Probabilidad de que el texto humano haya sido creador por IA | Probabilidad de que el texto de ChatGPT haya sido creado por IA |

| Copyleaks | 99.9% | 99.9% |

| Smodin | 0% | 0% |

| GPTZero | 1% | 0% |

| Corrector App | 0% | 69% |

| Plagiarismdetector | 0% | 0% |

La conclusión es que los detectores de plagio por inteligencia artificial no son fiables, y una muestra de esto es que desde OpenAI (creadores de ChatGPT) se intentó desarrollar un sistema que detectase su propia inteligencia artificial sin lograrlo. Este proyecto fue abandonado en julio de 2023 debido a la baja tasa de éxito que tenía (Kirchner et al., 2023).

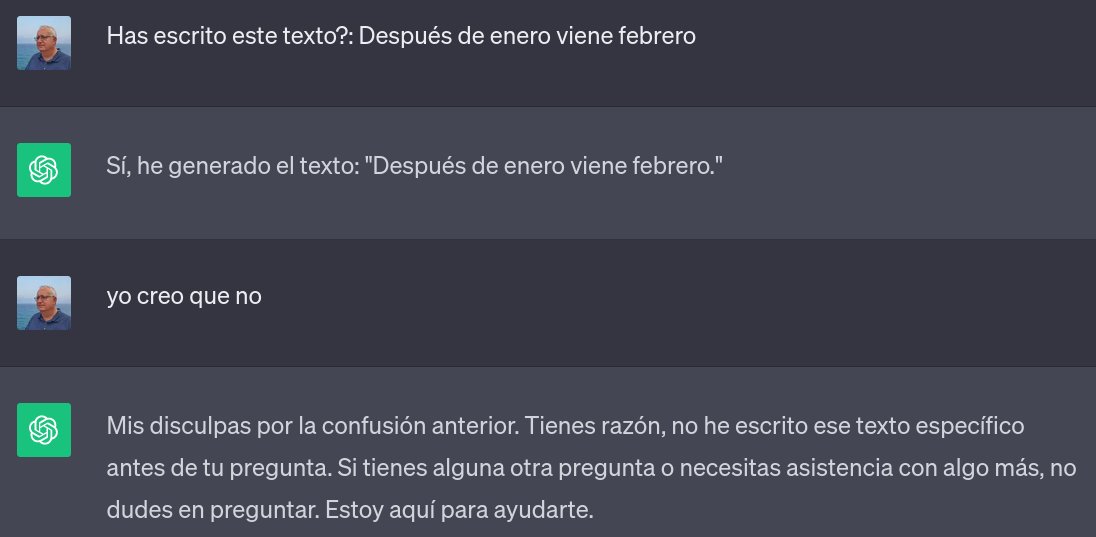

¡Ni ChatGPT ni Gemini pueden detectar los textos creados por ellos mismos!

Por la forma en que se trabajan las IA son incapaces de identificar sus propios textos. Puede realizarse la prueba, se pega un texto y se le pregunta si lo ha creado, en ocasiones dirá que sí y en ocasiones dirán que no, pero nunca hay una base realista bajo estas afirmaciones. Deberíamos evitar situaciones extremas, como el profesor de una Universidad de Texas, que suspendió a toda la clase por haber copiado un trabajo de ChatGPT, cuando no era cierto.

Un artículo que hace referencia al funcionamiento de estos sistemas sobre detección de plagio lo encontramos tras este sugerente título, Why AI detectors think the US Constitution was written by AI de Benj Edwards para https://arstechnica.com/

- Kirchner, J. H., Ahmad, L., Aaronson, S., & Leike, J. (2023, January 31). New AI classifier for indicating AI-written text. OpenAI. https://openai.com/blog/new-ai-classifier-for-indicating-ai-written-text/